朝のニュース解説‖こればっかりは自民党を応援せざるを得ないわな‖4/30

【結論】

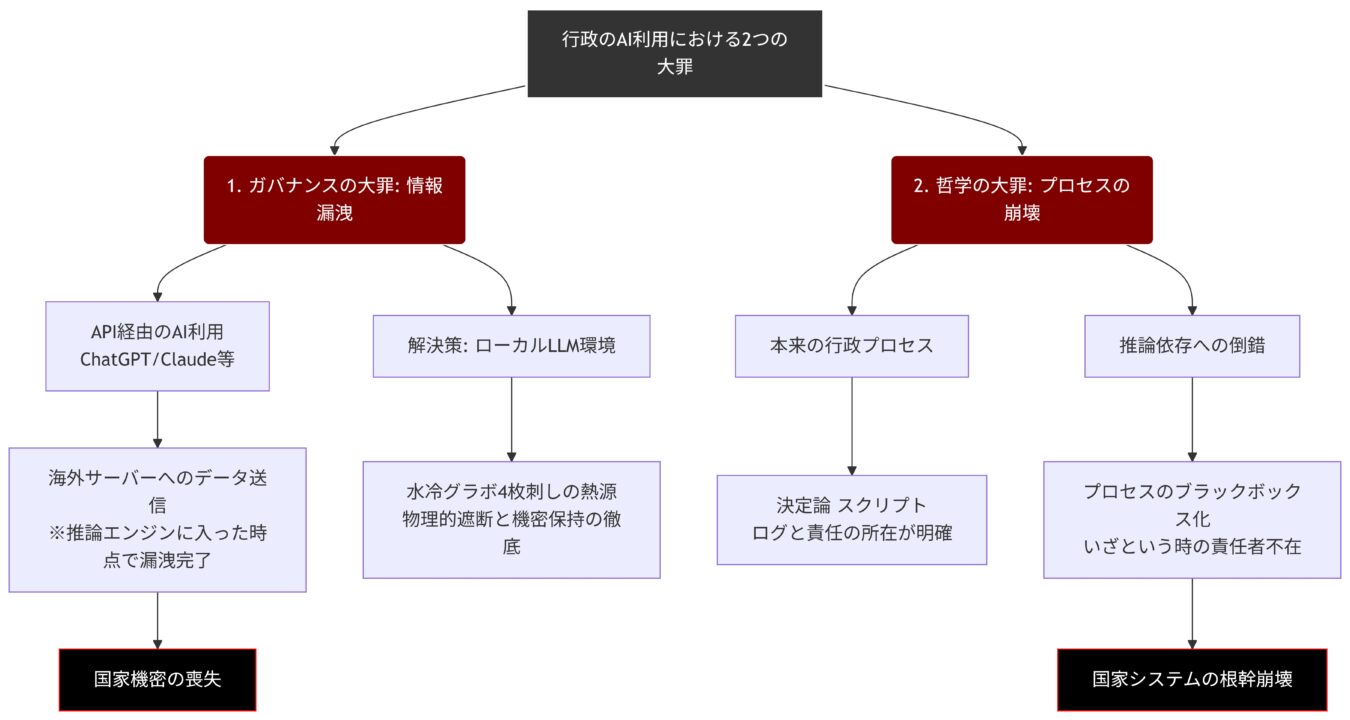

行政が「最先端」を気取ってAI(推論エンジン)を導入することは、国家機密を外部に垂れ流す最悪のセキュリティ・ホールであり、行政プロセスから「決定論」と「責任の所在」を消し去る哲学的な大罪である。

【ポイント3選】

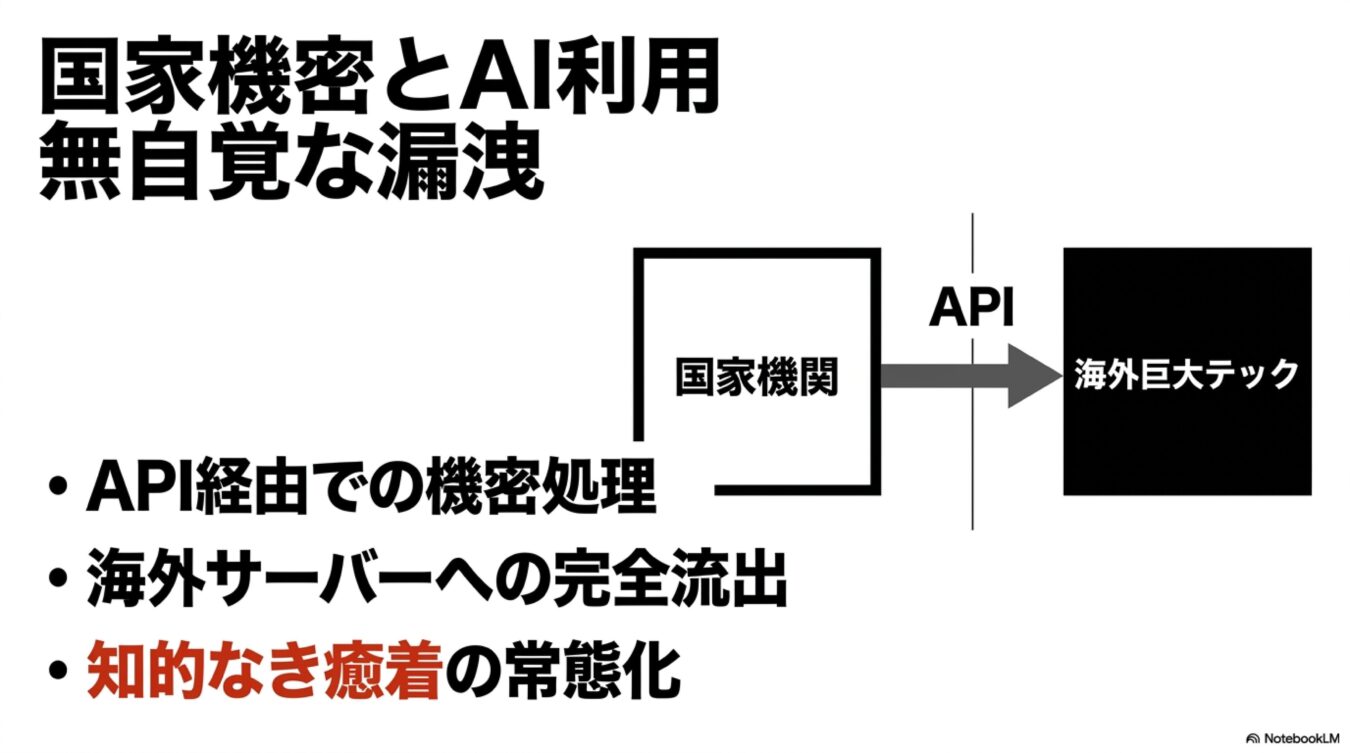

- 知的なき癒着: API経由のAI利用は、アメリカのサーバーに国家機密を直接放り込む「情報漏洩」に他ならない。

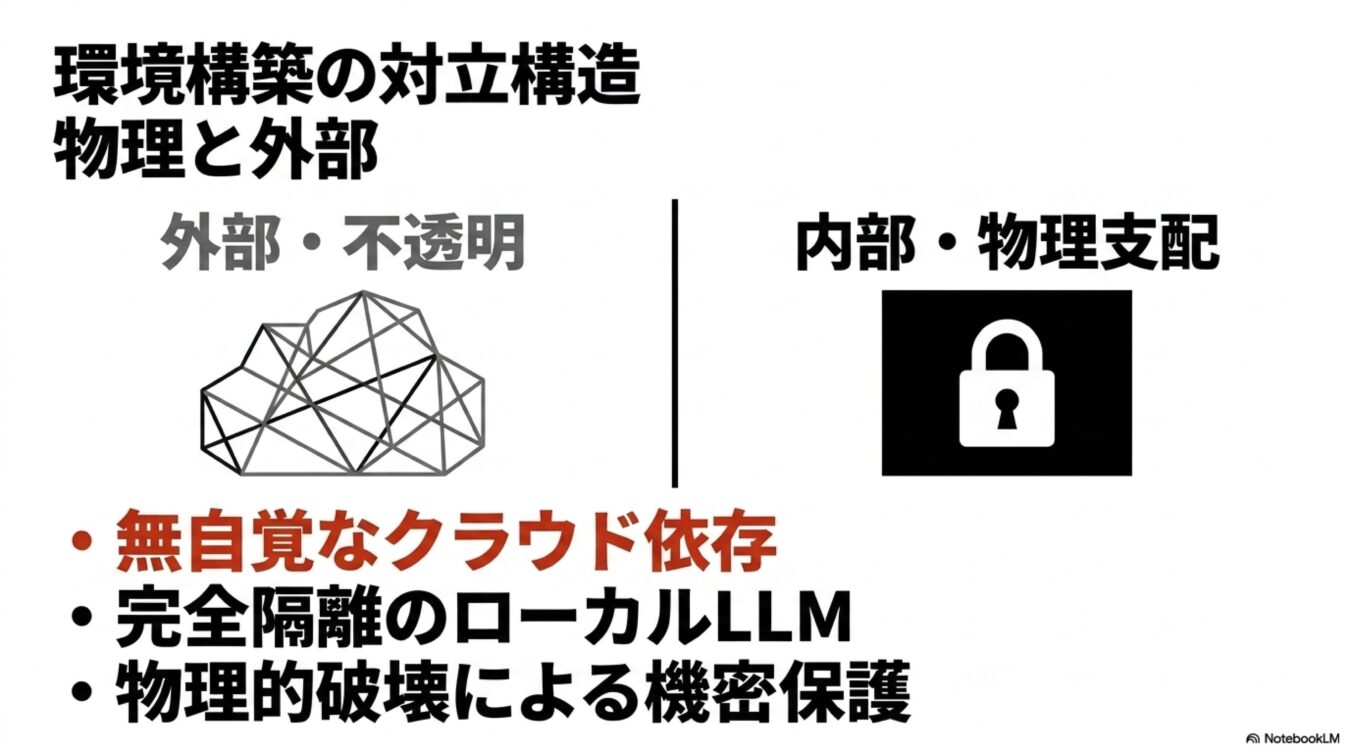

- グラボの熱を知らぬ無知: セキュアなローカルLLM構築(72Bモデルなど)の苦労も知らず、AWSにデータを置いて安心する政治家たちの底の浅さ。

- 哲学なき推論依存: ログと責任が残る「決定論(スクリプト)」を捨てて「推論(AI)」に頼ることは、国家のシステムを崩壊させる。

永田町にはびこる「AI使ってます」という無邪気な倒錯

小泉進次郎のドヤ顔が証明する「知的なき癒着」。AnthropicやOpenAIのAPIに国家機密を垂れ流す愚か者たち

永田町や霞が関で「我々もAIを活用しています」と胸を張る無邪気な倒錯が蔓延している。小泉進次郎あたりがドヤ顔で「AIに相談しています」などと宣っているが、控えめに言って正気の沙汰ではない。防衛大臣クラスの人間すら平気でそんなことを口にする。お前ら、自分が何をしているのか本当に分かっているのか?

AnthropicのClaudeであれ、OpenAIのChatGPTであれ、GoogleのGeminiであれ、それらのAPIを叩いて行政のデータを処理させるということは、アメリカの巨大テック企業のサーバーに国家機密をそっくりそのまま垂れ流しているということだ。「AIを使えば最先端」という知的なき癒着が生み出した、国家規模のセキュリティ・ホールである。

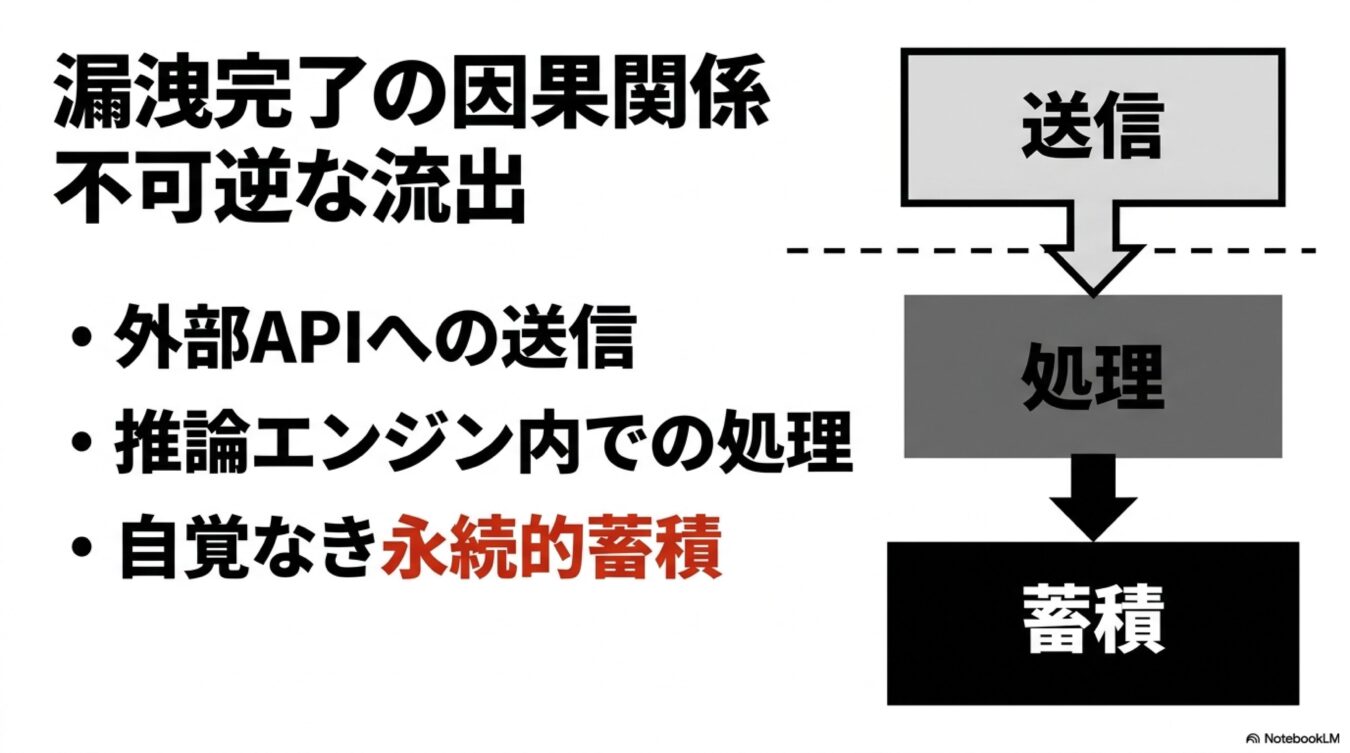

サーバーにデータが渡るという「事実」。推論エンジンに入った時点で情報漏洩は完了している

「通信は暗号化されているから大丈夫だ」などと寝言を言う輩がいるが、問題はそこではない。データが相手の推論エンジンに飛び込んだ瞬間、そこで情報は確実に処理され、向こうのログに残るのだ。つまり、推論エンジンに入った時点で「情報漏洩は完了」している。

民間企業ですら、最先端の現場では「社外のAPIに顧客データを投げるな」が鉄則になりつつある。それなのに、国の機密を扱う政治家や官僚が、なんの痛痒も感じずにプロンプトへ機密情報を打ち込んでいる。企業でアンソロピックのAPIを使ってシステム開発をしている連中も同じだ。毎日せっせと情報漏洩に加担している自覚すら持たず、我々が裏でガリガリとコードを書いているためのトークン代(肥やし)を払わされているだけだということに気づきもしない。

グラボの熱も知らない政治家たちへ。ローカルLLMを語れないなら黙っていろ

防衛大臣の執務室はサウナであるべきだ。「72Bのモデル」も知らない永田町の連中

国家機密のような絶対に外部に出せない情報をAIで処理し、いざとなればグラボごと物理的に叩き割って溶解処分して機密を守る。もし政治家が本気でセキュリティを担保してAIを使いたいなら、防衛大臣の執務室には水冷グラボを4枚挿しにしたマシンを置き、80度近い熱源で部屋中をサウナのようにして「72B(720億パラメータ)」の巨大なLLMをローカルで回していなければ嘘だ。

「72Bのモデル」と言われて「かぼちゃワインですか?」とボケるような永田町の連中に、国家のデジタル戦略を語る資格はない。私自身は外部APIに安易に依存せず、自身の思考のノウハウ(プロンプトの調整履歴)をAIの学習データとして奪われないよう、ModalやVast.aiといったクラウドGPUサービスを時間借りで利用してセキュアな環境を構築している。

「チームみらい」の底の浅さ。AWSにデータを置き、ModalやVast.aiのセキュリティ構造すら理解しない連中

「チームみらい」だか何だか知らないが、彼らもすぐに「行政の処理をAI化しよう」と口走る。だが、その実態はどうだ。「AWSに置いているから安全だ」などと思考停止しているのではないか。

世界中のエンジニアは今、ModalやVast.ai、あるいはエンタープライズ向けのHyperstackといったサービスを駆使し、どうやってセキュアな環境でGPUを時間借りし、コールドスタートでモデルを立ち上げ、学習させずに処理だけを完結させるか、血みどろの試行錯誤をしている。そうしたセキュリティ構造の根本すら理解せずに「AI活用」を掲げる連中の底の浅さには、心底呆れ果てる。

【核心】行政が「推論(AI)」を使うという哲学的な大罪

行政プロセスは「決定論(スクリプト)」でなければならない。ログ(証拠)と責任の所在を消し去るな

ここからが最も重要な本質だ。百歩譲ってローカルの完全にセキュアな環境でAIを動かしたとしよう。それでも、行政がAIを使うことには「哲学的な大罪」が伴う。

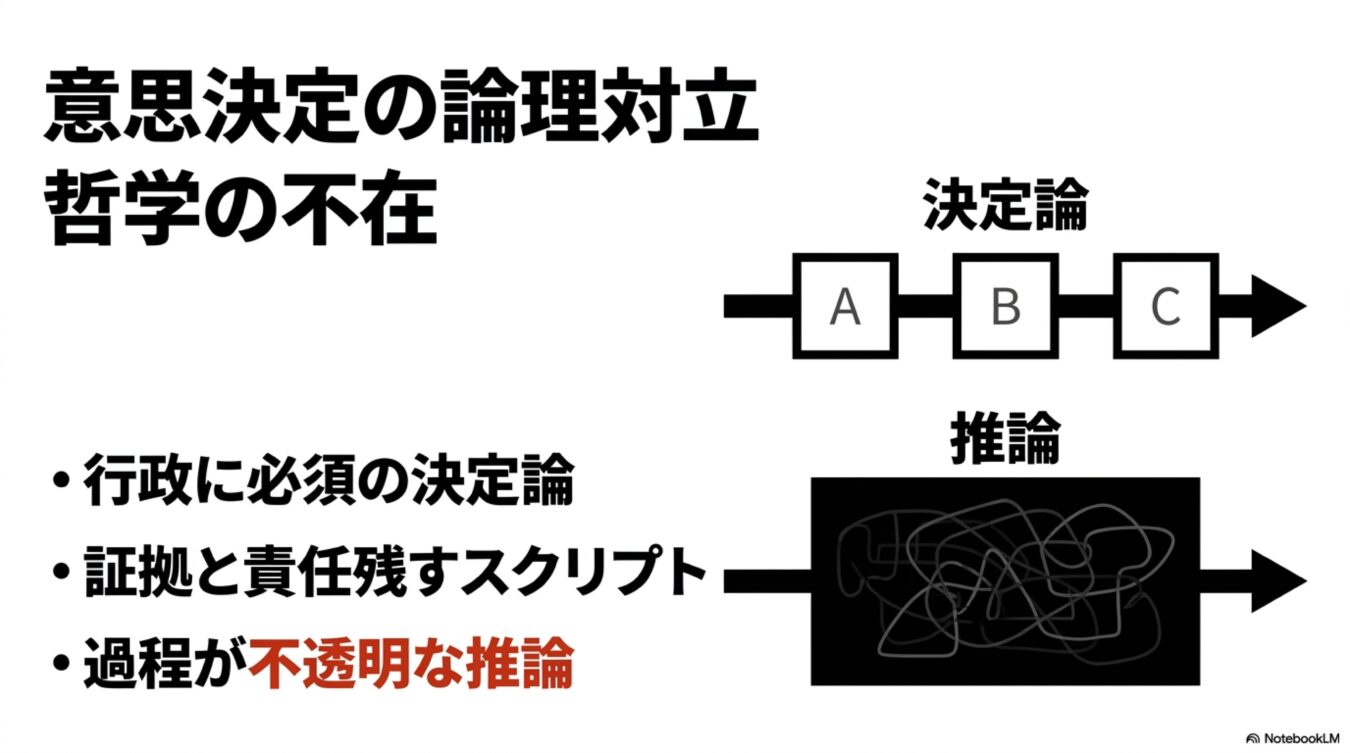

行政の意思決定プロセスは、いかなる場合も「決定論(フローチャートやスクリプト)」で動かなければならない。Aという条件を満たせばBになる。そこに揺らぎがあってはならないし、何より「なぜその決定を下したのか」というログ(証拠)が完全に残らなければならない。

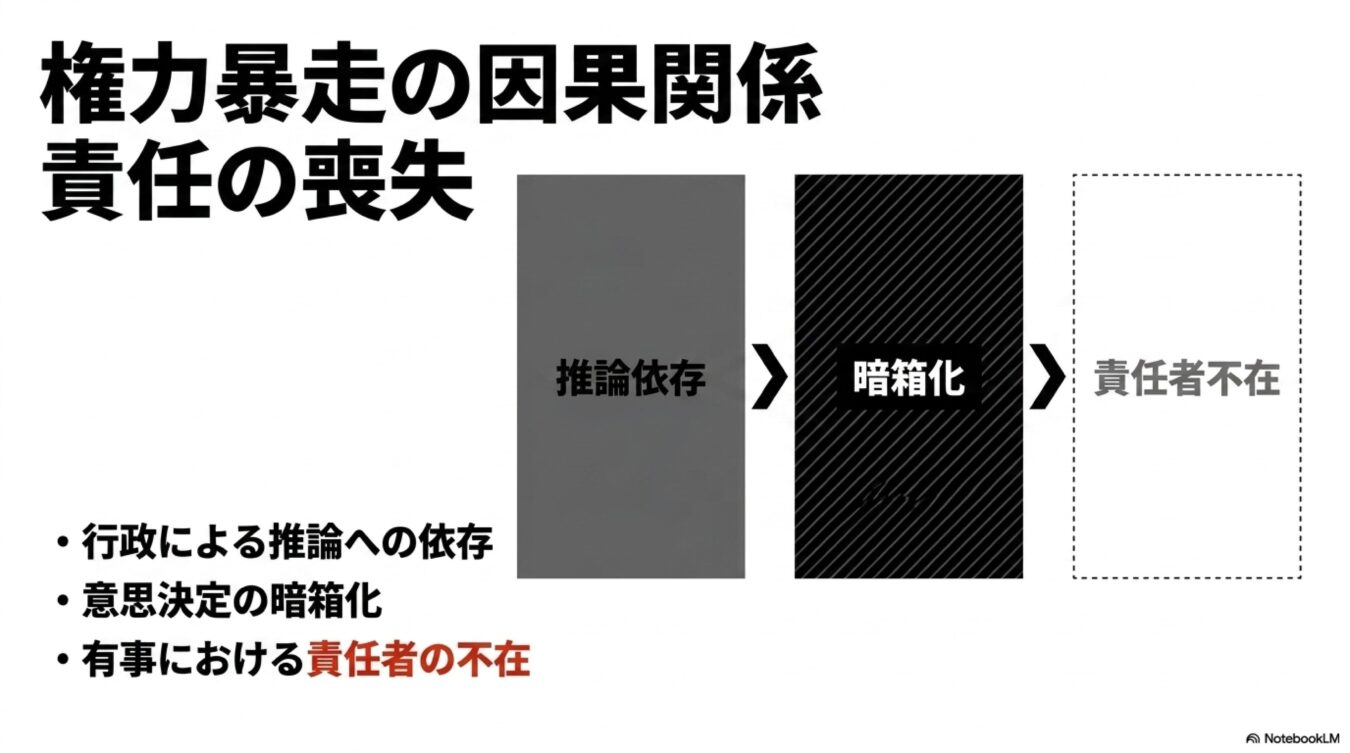

しかし、AIは「推論」である。推論である以上、プロセスはブラックボックス化し、確実な意思決定の痕跡が残らない。行政が決定論から足を踏み外し、推論に依存したとき、いざという時に責任を取る人間が不在になるのだ。私が「最新技術を使うな」と言っているのではない。「行政の仕事はスクリプトでやれ」と言っているのだ。

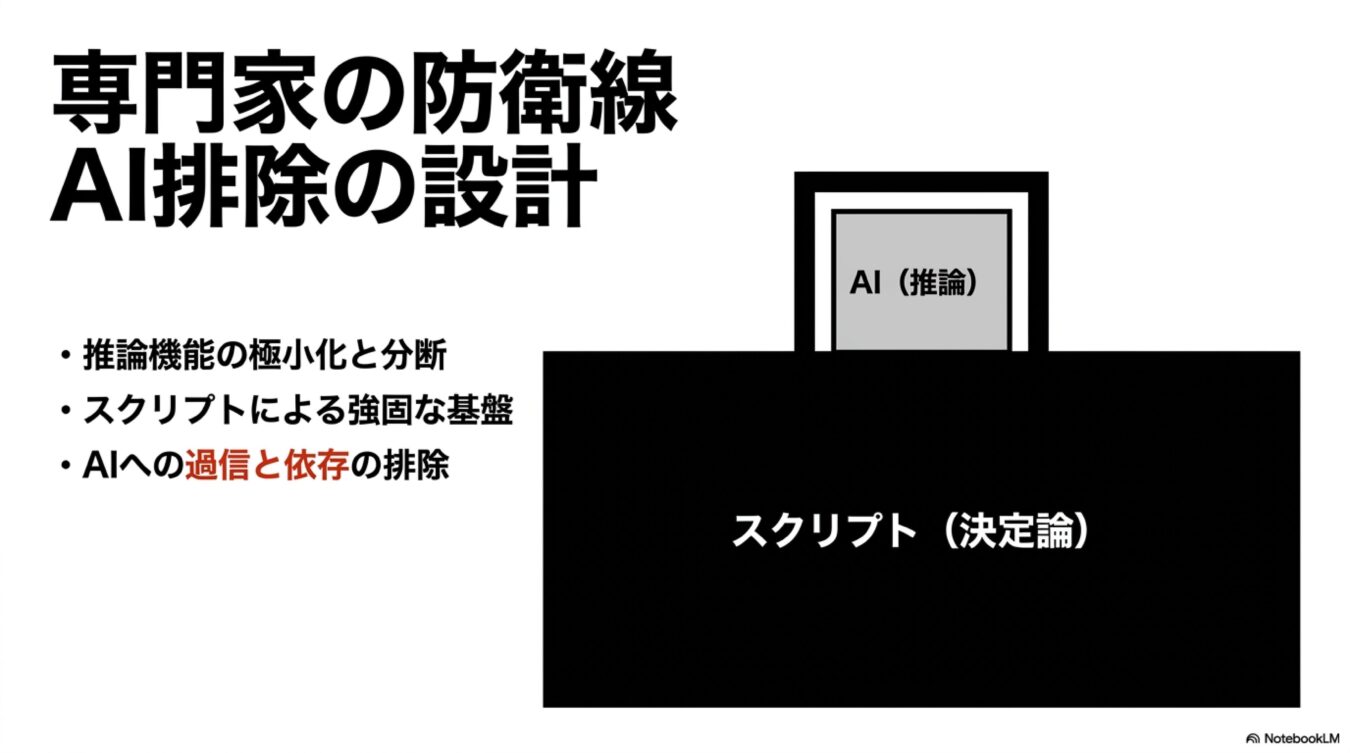

プロのエンジニアほど「いかにAIに仕事をさせないか」を設計する。AI全盛時代に最後まで残るのは哲学者だ

ガチの最先端でシステム設計をしているプロのエンジニアほど、今「いかにAIに仕事をさせないか」を必死に考えている。AIがどれほど高機能になろうと、金を扱う業務や機密性の高い処理において、AI(推論)を徹底的に排除し、スクリプト(決定論)で固めることに心血を注いでいる。AIに任せるのは、どうしても推論が必要な「多言語の要約」や「翻訳」といった極一部のレイヤーだけだ。

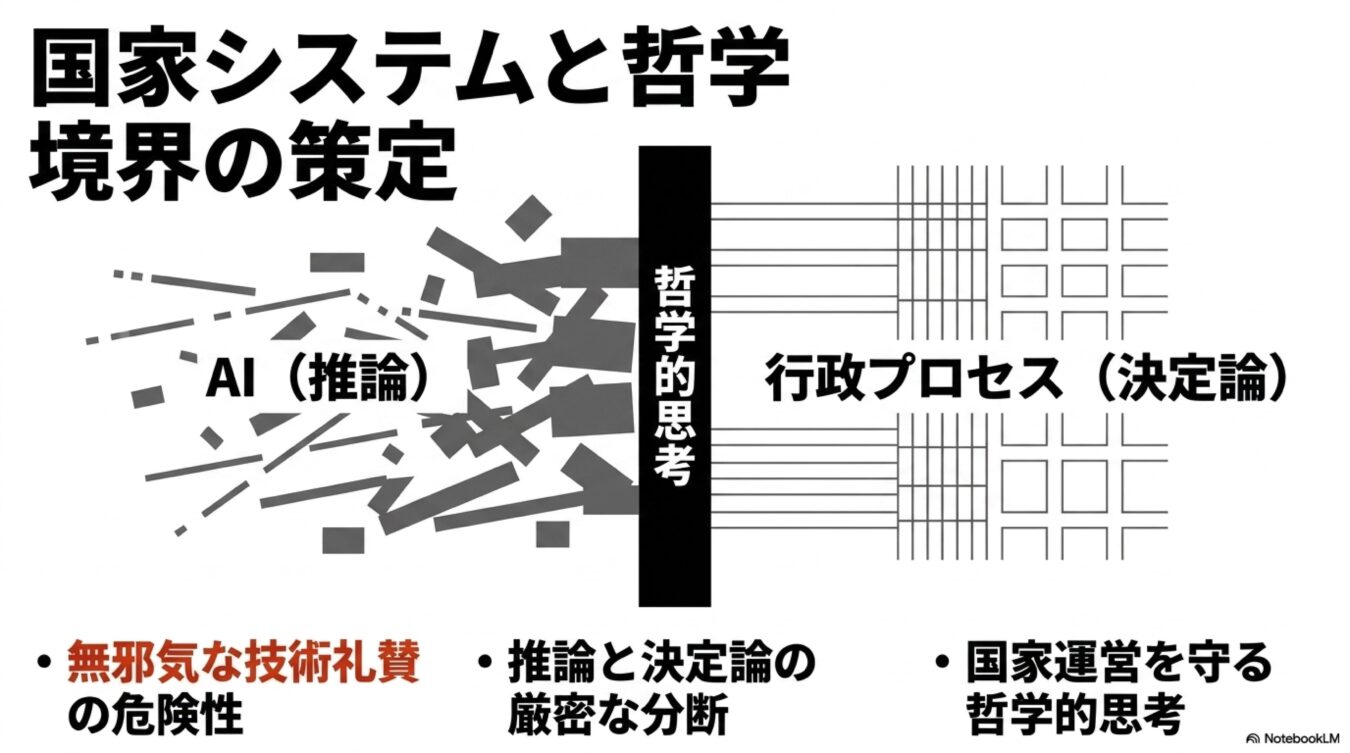

「ここは推論で処理していいのか?」「ここは決定論で縛るべきではないか?」——人間が介入すべきか否かを切り分けるこの問いは、演繹でやるか帰納でやるかという純粋な「哲学」である。AI時代に最後まで必要とされるのは、AIを無邪気に褒めそやす人間でも、単なるコーダーでもなく、哲学者なのだ。

その根本的な哲学すら持たず、「AIを使えば便利になる」と浮かれている永田町の連中に、国家のシステムを任せることの恐ろしさを、我々はもっと自覚すべきである。

【検証用ソース】事象の裏付け

- 政治家がAPI経由でAIを使い、情報を漏洩させている事実の指摘(2:14:56〜)

- 小泉進次郎のAI利用自慢と、それがいかに無知で恐ろしい行為かへの批判(2:16:08〜)

- ローカルで72Bのモデルを動かすためにGPUを稼働させている自身の環境と情報保全の徹底(2:17:12〜)

- 「チーム未来」が安易にAWS等を利用することへのセキュリティ的脆弱性の指摘(2:18:26〜)

- 行政が「決定論」から足を踏み外し、「推論」であるAIを使うことの哲学的危険性(2:20:45〜)

- 行政の仕事はスクリプトで動くべきであり、証拠(ログ)が残るべきだという本質論(2:25:13〜)

- 最先端のエンジニアほど「いかにAIに仕事をさせないか」を日々考えているという実態(2:27:26〜)

「小泉進次郎とかあの辺の連中がいかに無邪気に国家機密をAIに垂れ流してるか、これでよう分かってもらえたと思う。でもな、永田町のガバナンス崩壊ってのは、何もデジタル空間に限った話やないんよ。

次に取り上げるのは、高市早苗の『夫の介護』問題。これな、本人はお涙頂戴の感動ポルノのつもりなんやろうけど、総理の公邸っていう『TOP SECRET』がそこら中に転がってる最高機密空間に、民間の訪問介護士をホイホイ入れようとしてるってことやからね。民間人に死ぬまで国家機密保持(NDA)をどうやって負わせ続けるんやっていう、オペレーションの根幹が完全に抜け落ちてるわけですよ。映画『アルマゲドン』で、穴掘り職人に宇宙飛行教えるのと同じくらいアホな矛盾を、この国の中枢は本気でやろうとしてる。

『かわいそう』とか『勢い』だけで、過去のルールとのすり合わせとか、丁寧な合意形成の手続きを平気でゴミ箱に捨てる。こういう自民や維新特有のファシズム的な病理がどういう構造になってるんか、次の記事でみっちり解体してあるんよ。

この国の政治がいかに『感情』だけで危うい橋を渡ろうとしてるか、続きのページを開いてもらえたら、俺の言うてる意味が嫌でも腑に落ちるはずやわ。ほな、次の記事でまたお会いしましょう。」

コメント