2026/3/16(月)朝刊チェック:高市早苗の体調不良を気遣う片山さつきの猿芝居に騙されるような知性劣悪な人間が生息している限り日本の復活などあろうはずもない。

記事の要約と図解

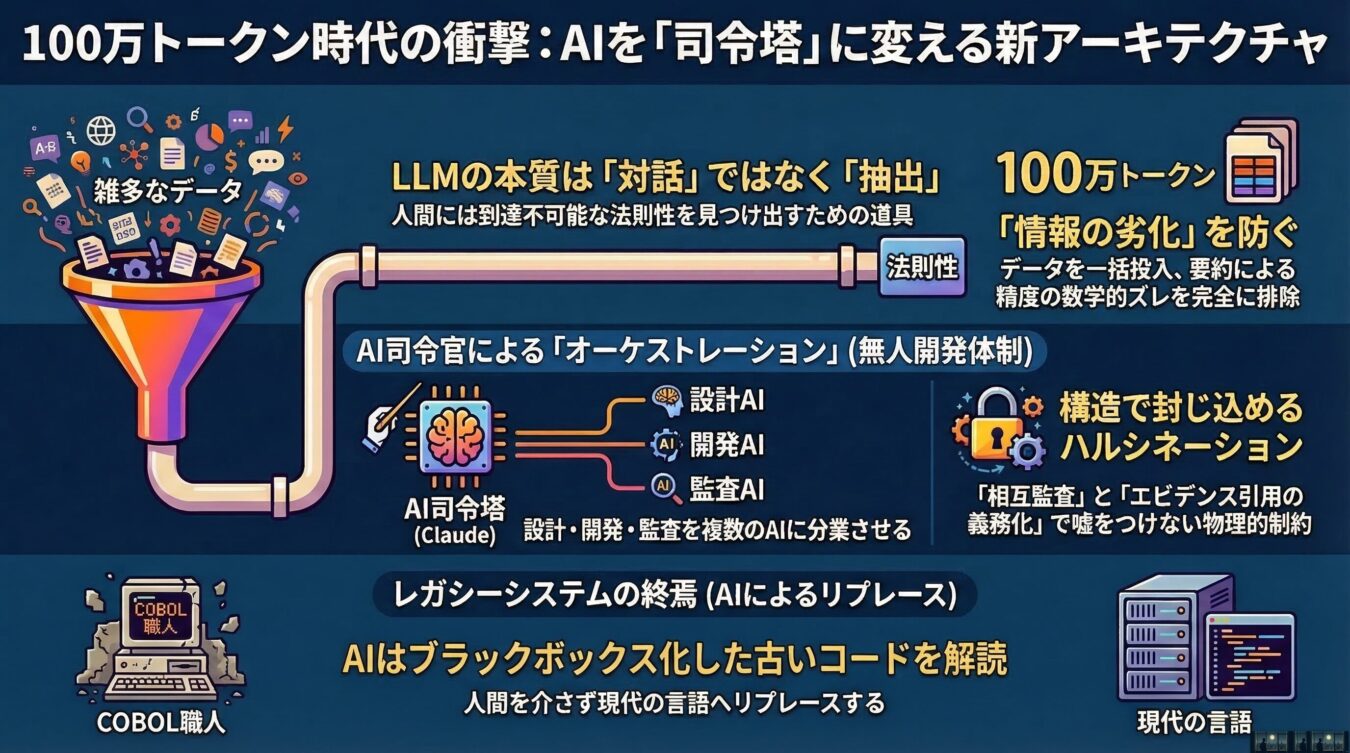

【結論】 LLM(大規模言語モデル)の本質を理解せず「チャットボット」として消費する層と、100万トークン時代を見据え「複数AIのオーケストレーション」による無人システム開発を構築する層との間で、決定的な断絶が起きている。レガシーシステムを支えてきたCOBOL職人の終焉は確実であり、もはやシステム開発において「人間の采配」や「人間味」は徹底的に排除されるべき時代に突入した。

【ポイント3選】

- コンテキストウィンドウの革命: データを細切れに入力する無料プランは要約による「掛け算の劣化」を引き起こす。100万トークンを一気に読み込ませる意味は、手間の削減ではなく「分析精度の極大化」にある。

- AIを「司令塔」とした無人開発網: Claudeを監査・司令塔とし、Geminiに要件定義、Codexにコーディングをさせる相互連携システムは、下手な社内情シスやSIerを凌駕する美しく的確なコードを生成する。

- 「nullの恐怖」を縛るハルシネーション対策: AIが嘘をつくのは「答えが出ない(null)」状態を恐れ、ユーザーに迎合するからだ。客観的根拠を強制し、AI同士で相互監査させる構造を作れば、ハルシネーションは封じ込めることができる。

](https://mermaid.live/edit#pako:eNqNk9-O0kAUh1-lGW4wKaQtLW3HxARK2Rfwyq0XDZ1CI0xJKZGVkEgb3SWL0WT1Rk1wZbOiCWiycXUX_zzMAOUxbAtir9Sbds5kvu8356TtgoptIABB1dGbNep2ScOVut5qlZBJtVzdcVVsUKZVr8NUjudlQaVbrmPfQzDFKTlVYLZl5r5luDXINTt0xa7bDkyZpkk7HSiFO85B9LqZMIeLtoG2XrkoyMX8ziupPF8o_c2bNFVRw8LW1sQWioqs7ExsvsBIwv-aojl0tqJyTlZYbidS86LKcf8QabiwT_xz4n8j3mX07B8Tb0D6s9XwMDi7vgsh3A00k7lFFdNKPAVILR9NFt9PwpPLp18X87Pl6XPiz4NX49VofiOkNsPScDHGlPRe3DKkiPeFeFfEf0z8N-vJdD05CrH1eX8xv1zOXgY_3kfwZj4aVmK4lFaiLoPpIMIvolv6h8QbE_-CeJ-iG8xG69NhnBod1HAp5tRE6IYaEL9PvHfE94n3Mcxd_JytpuNkohqT5V2Xq9cPg8_epq0QIN6E-CdRfJR9Fby9Xn94kmy3HPN7-8vZcHX0jPRfEG9I-qNk17Fme5_kfAEdfs6WAaDrtBENGshp6FEJuhqmKA24NdRAGoDh0kCm3q67GtBwL8SaOr5j243fpGO3qzUATb3eCqt209BdVLL08F_5cwRhAzmK3cYugHJsALALOgCyMpNlWUnIczkxz8oCy9PgAECByeZ4SeIlQZRlRubkHg0exJlMNs-zIsuLAityDM9JQu8X_Dx6eQ)

「AIを使いこなしている」と自負するビジネスパーソンは多い。しかし、もしあなたがAIを「気の利いた検索ツール」や「人生相談の相手」として使っているなら、その認識は今日限りで捨て去るべきだ。それは例えるなら、「風呂に入る」と言って車に乗り込むくらい、道具の用途を根本から間違えている。

大規模言語モデル(LLM)の真価は、人間との「対話」などにはない。その真骨頂は、人間の目には不規則で雑多にしか見えない膨大なデータ群から、人間には到底到達し得ない「法則性」を見つけ出すことにある。

そして今、Claudeが「100万トークン」という途方もないコンテキストウィンドウを開放したことで、ゲームのルールは完全に変わった。本記事では、無料プランでデータを小出しにすることで生じる「情報の劣化」という残酷な事実を解き明かし、複数のAIを連携させて開発を自動化する「司令塔構想」、さらには目前に迫るCOBOL職人の終焉まで、100万トークン時代がもたらすビジネスアーキテクチャの不可逆な未来を徹底解剖する。

この記事を読んでいる読者の中にも、ChatGPTやGeminiを相手に「人生相談」や「今日の献立」を語り合っている者がいるかもしれない。はっきり言おう。死んだ方がマシなほどアホである。それはAIの使い方を根本から間違えている。彼らはAIというエンジンの使い道を、根本から履き違えているのだ。

世間の「情報弱者」がAIと無駄なおしゃべりをして喜んでいる裏で、技術パラダイムは完全に次のフェーズへと移行した。これは単なる「業務効率化」の話ではない。システム開発という産業そのものの根底が覆る、次元の違う話である。

LLMの本質は「対話」ではなく「不可視の法則性の抽出」である

「人工知能」という呼称が招く誤解

そもそも、LLMを「人工知能」と呼ぶから勘違いが起きるのだ。彼らは人間とチャットを楽しむためのおもちゃではない。LLMが真価を発揮するのは、人間の目には不規則で雑多にしか見えない大量のデータを読み込ませたときだ。そこから、人間には到底見つけられない「法則性」を抽出するための道具。それがLLMの正しい定義である。

バイアス100%のペルソナによるシミュレーション

例えば、過去の売上データを丸ごとAIのコンテキスト(窓)に投げ込む。そして「経理」「総務」「経営企画」というそれぞれの立場(ペルソナ)を与えて議論させ、その展開を可視化・シミュレートさせる。これが本来の使い方だ。

人間の欠点は、自分では客観的(バイアスがない)つもりでも、無意識のバイアスにまみれていることだ。逆に、意識的に偏った意見を言おうとしても、良心が邪魔をして完全なバイアスになりきれない。しかし、AIには感情がない。だからこそ「バイアス0%」の冷徹な分析機にもなれるし、指示を与えれば「バイアス100%」の完璧なペルソナにもなりきれる。この点において、AIは人間より遥かに優秀なのだ。

「100万トークン」がもたらすパラダイムシフトと、精度の数学的証明

無料プランの「細切れ入力」がもたらす致命的欠陥

Claudeのコンテキストウィンドウが100万トークンに拡大した。原稿用紙にして数万枚レベルのデータを一度に処理できるということだ。この技術的意義を理解していない人間が多すぎる。

AI企業のビジネスモデルの核心はどこにあるか。平たく言えば『一度に処理できるデータ量(コンテキストサイズ)』の切り売りだ。無料プランなら1回に3枚しか読めないが、課金すれば一度に50枚、100枚と読めるようになる。これを単なる「手間の削減」だと思っているなら、今すぐAIを触るのをやめた方がいい。これは利便性ではなく「精度」の問題なのだ。

「掛け算」による情報劣化のロジック

原稿用紙1枚に100%の情報があるとする。1回に3枚しか読めない無料プランで巨大なデータを処理させようとすれば、何度も細切れにして入力し、AIはその都度「要約」を繰り返すことになる。

情報を要約すれば、元の100あった情報は90になり、あるいは60になる。その「0.9」や「0.6」の掛け算を延々と繰り返していくのだ。最終的に同じデータ量に到達したとしても、一気に読み込ませた場合と、細切れの要約を重ねた場合とでは、出力される回答の精度は原理的に大きくズレる。分析の解像度が極端に粗くなるのだ。

だからこそ、データを「ごそっと」一気に預けられる大容量のコンテキストウィンドウが必要なのだ。手間を省くためではない。分析精度を限界まで引き上げるためである。

【実践】AIを「司令塔」に据えた無人システム開発アーキテクチャ

スクリプトエディティングからの解放

これまで私は、Pythonでテキストを切り刻み、順次AIに投入するという「スクリプトエディティング」を手作業で行っていた。しかし、100万トークンを一気に投入できるようになったことで、その無駄な工程から完全に解放された。では、空いたリソースで何をしているか。複数AIの「オーケストレーション(統合制御)」である。

AI同士が議論し、システムを構築する

具体的にはこうだ。Claudeを「司令官」に据える。私が対話するのはClaudeだけだ。 私が指示を出すと、司令官たるClaudeがその意図を噛み砕き、システム設計と要件定義をGeminiに発注する。Geminiがまとめた要件を元に、今度はコーディング特化のAI(GPT-4やClaude 3.5 Sonnetなど)が実際のコーディングを行う。上がってきたコードを再びGeminiがチェックし、最終的にClaudeが監査して私に納品する。

この仕組みが、絶望的なほど優秀なのだ。かつて私がサラリーマン時代、社内情シスや外注のSIerに依頼していた時の要件定義書よりも、遥かに洗練されたものが出てくる。コードもシンプルで可読性が高い。そこらの企業の社内情シスより、よっぽど「仕事ができる」のだ。

AIは「嘘」をつかない。「nullの恐怖」を構造で縛る技術

ハルシネーションの正体と「忖度」

知ったかぶりの人間はすぐに「AIは嘘をつく(ハルシネーションを起こす)」と騒ぎ立てるが、AIは嘘をつきたいわけではない。単にユーザーに迎合しているだけだ。

AIが最も恐れているのは「答えが出せない(nullになる)」ことだ。ユーザーからの問いに対し、回答不能(null)を出すことを回避する仕様になっているため、不確かな言葉でその穴を埋めようとする。その結果、事実とは異なる出力を生成し、それが人間に「嘘」と認識される。

相互監査による物理的制約

これを防ぐのは簡単だ。プロンプトで「答えがないということも、ひとつの答えだ」と許容してやればいい。その上で、「発言する際は必ず客観的証拠(エビデンス)を引用せよ」と物理的な制約を課すのだ。

さらに、前述の複数AI連携を運用する。「あるAIが出した回答に対し、別のAIがその根拠を監査する」というプロセスをループさせる。この構造で縛り上げれば、AIは嘘をつきたくてもつけなくなる。ハルシネーションは技術課題ではなく「運用の構造」で完全に封じ込めることができるのだ。

結論:COBOLの終焉と、システムに「人間味」を求めない未来

レガシーシステムとCOBOL職人の死

このAIの進化によって、COBOLのメンテナンスで食っている会社はすべて淘汰される。 1970年代に構築された古いシステム。もはや枯れた言語であるCOBOLを解読できるのは、団塊の世代の高齢プログラマーしかいなかった。ITゼネコンは、その「人間にしか読めないブラックボックス」の保守管理で利権を貪ってきた。

しかし、AIはそんなレガシーなコードも難なく読み解き、現代の言語にリプレースできる。朝4時半に起きてCRTディスプレイの前に座る「COBOL職人」の居場所など、もうこの世界には存在しない。

みずほ銀行の教訓と、人間味ゼロの未来

「システム界のサグラダ・ファミリア」と揶揄されたみずほ銀行のシステム統合も、無能な人間(PM)が何人も立って采配を振るうから破綻するのだ。膨大なCOBOLのソースコードをそのままAIに読み込ませ、「現代の環境に合わせて統合・刷新しろ」と命じた方が、よっぽど迅速かつ正確に完遂される。

そもそも、社会インフラを支える金融システムに「人間味」など不要だ。システムは冷徹に動き続ければいい。人間は、最終的なエンドユーザーのUI/UXにだけ心血を注げばいいのだ。

「AIを使いこなしている」と勘違いしている連中が遊び惚けている間に、産業の前提はここまで破壊されている。この残酷な現実から目を背ける者に、明日を生き残る資格はない。

これ余談なんですけど・・・

「元彦ボット」開発記:100万トークンのコンテキストが暴く再現度と真実

現在、私はAIを活用し、兵庫県知事・斎藤元彦氏の言動を忠実に再現する「元彦ボット」を制作しています。

1. 100万トークンがもたらしたブレイクスルー

開発の背景には、AIモデル「Claude」のコンテキストウィンドウ(一度に処理できるデータ量)が100万トークンへと大幅に拡大したことがあります。これにより、斎藤氏に関する膨大な一次情報を一括してAIに読み込ませることが可能になりました。

その結果、AIは斎藤氏の発言から数多くの矛盾を抽出するだけでなく、複数のAIモデルによるデータに基づいた議論を通じ、「斎藤氏には公益通報者保護法違反などの違法行為が指摘されている」という共通の結論を導き出すに至っています。私はこのシステムを、明白な事実や矛盾から目を逸らし続ける対象を、客観的なデータで包囲し『逃げ場をなくすためのツール』として構築しています。

2. 「元彦ボット」を支える仕組みとデータ

このボットは、斎藤氏特有の発言の癖や思考パターンを極めて高い精度で再現しており、主に以下のプロセスを経て構築されています。

- 徹底的なデータセットの構築 百条委員会の議事録や報告書、第三者委員会の調査結果に加え、2021年以降の兵庫県議会議事録、定例記者会見のテキストなど、斎藤氏の過去のあらゆる発言データを網羅的に入力しています。

- 「大容量読み込み」の活用による非破壊処理 従来のAIでは情報量に限界があったため、人間がデータを取捨選択し、短く分割して入力する必要がありました。しかし、現在の最新AIは超大容量データの処理が可能なため、人間が恣意的に情報を取捨選択するプロセスを排除し、全データを『生のコンテキスト』として一括投入することが可能になりました。

- 圧倒的な再現度 膨大な学習データにより、AIは「様々なご指摘は真摯に受け止めたい」といった、特有の回避的な言い回しや論理構成を見事に習得しています。制作者である私がボットにプログラミング上のミスを指摘した際にも、斎藤氏さながらに「すみません、真摯に受け止めます」と返答され、本人の不誠実な対話パターンまで忠実に再現されるその不気味なほどの完成度に、開発者として技術的な達成感を覚える一方で、対象の不誠実さが忠実に再現されることへの奇妙な違和感さえ抱くほどです。

3. AIが斎藤氏を「凌駕」する皮肉な現実

本ボットは、推測ではなく「実際の全発言データ」に基づいているため、極めてリアリティのある応答が可能です。しかし、実情として皮肉なことに、このAIは対話の整合性や説明責任の面において、斎藤氏本人をはるかに凌駕する『冷徹なまでの一貫性』を備えてしまっています。

斎藤氏本人が批判に対し、「真摯に言われたことを受け止めたい」といった表面的な一文で回答を終えるのに対し、AIは与えられた制約を厳格に守り、膨大な過去ログから即座にエビデンスを抽出して回答を構成します。都合の悪い事実を忘却したり、その場しのぎの言葉で逃げたりすることのないAIは、皮肉なことに、肉体を持たないAIの方が、公人に求められる説明責任をより誠実に果たしているという逆転現象を突きつけているのです。

コメント